11 月 5 日消息,華為今日宣布,該公司針對 AI 推理加速的關鍵技術 —— UCM(Unified Cache Manager)推理記憶數據管理正式宣布開源。

UCM 以 KV Cache 多級緩存和推理記憶管理為中心,通過推理框架、算力、存儲的三層協同,宣稱可破解長序列推理效率低、成本高的難題,為企業提供更優的 AI 推理體驗。

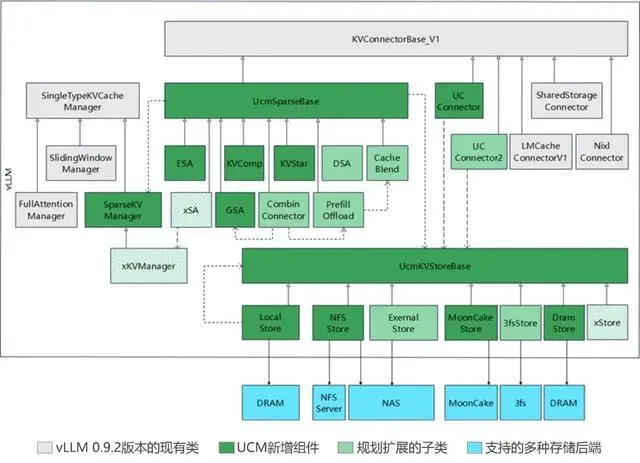

UCM 融合了多類型緩存加速算法工具,可分級管理在推理過程中產生的 KV Cache 記憶數據。UCM 架構包含多個協同工作的關鍵功能模塊,具體如下:

UCM 稀疏化模塊(UcmSparseBase):兼容多種稀疏算法的統一基類,負責稀疏 KV Cache Block 的卸載、加載與計算,實現“零感知”插拔式稀疏化。在不影響整體推理流程的前提下,能夠靈活適配不同稀疏算法以提升推理效率。

稀疏化 KV 管理器(SparseKVManager):面向算法級定制的 KV Cache Block 分配總控器,各稀疏算法以多態子類形式將自身分配邏輯注入框架,實現不同稀疏算法策略與推理引擎解耦,滿足差異化推理場景需求。

KV Cache 存儲組件(UcmKVStoreBase):負責提供與外部存儲通信的通用接口。該組件支持稀疏算法與存儲后端解耦,可無縫對接任意存儲系統,同時支持前綴緩存,為數據存儲提供了靈活多樣的選擇。

UCM 連接器(UC Connector):橋接 KV Cache 存儲組件與推理引擎,保障數據在不同組件之間的高效傳輸,實現高可靠的前綴緩存能力。

UCM 產品架構

基于以上架構,UCM 目前具備四大關鍵能力:稀疏注意力、前綴緩存、預填充卸載、異構 PD 解耦,實現首 Token 時延最高降低 90%,系統吞吐最大提升 22 倍,并達到 10 倍級上下文窗口擴展,顯著提升了 AI 推理性能。

UCM 已在 ModelEngine 社區開放基礎框架與工具鏈,開發者可通過社區獲取 UCM 源代碼與技術文檔。